AI Fußball Tipps simuliert: Monte-Carlo und die virtuelle Spielwiederholung

Sportvorhersagen

Ladevorgang...

Ladevorgang...

Stellen Sie sich vor, Sie könnten ein Fußballspiel nicht einmal, sondern zehntausendmal spielen lassen. Jedes Mal mit leicht veränderten Bedingungen, mit anderen Zufallsereignissen, mit unterschiedlichen Wendepunkten. Am Ende hätten Sie nicht ein Ergebnis, sondern eine Verteilung von Ergebnissen. Sie wüssten, wie oft das Heimteam gewonnen hat, wie oft das Auswärtsteam, wie oft es unentschieden endete. Diese Information wäre ungleich wertvoller als eine einzelne Vorhersage, weil sie die Unsicherheit explizit machen würde.

Genau das leisten Simulationsmodelle. Sie spielen Fußballspiele virtuell durch, nicht einmal, sondern tausende Male. Die Methode heißt Monte-Carlo-Simulation, benannt nach dem berühmten Kasino, und sie ist eines der mächtigsten Werkzeuge der modernen Sportanalyse. Was früher Tage an Rechenzeit erfordert hätte, erledigen heutige Computer in Sekunden. Die Ergebnisse fließen in KI-Prognosen ein und ermöglichen differenziertere Aussagen als einfache Punktschätzungen.

Dieser Artikel erklärt, wie Simulationsmodelle im Fußball funktionieren. Er beschreibt die Mathematik hinter der Monte-Carlo-Methode, zeigt, wie Spiele und ganze Saisons simuliert werden, und diskutiert die Stärken und Grenzen dieses Ansatzes. Denn wer versteht, wie die Simulationen funktionieren, kann ihre Ergebnisse besser einordnen und klügere Entscheidungen treffen.

Was Simulation im Fußballkontext bedeutet

Simulation ist nicht dasselbe wie Vorhersage. Eine Vorhersage sagt, was am wahrscheinlichsten passieren wird: Bayern gewinnt, Dortmund verliert, das Spiel endet 2:1. Eine Simulation hingegen erzeugt eine Vielzahl möglicher Zukünfte und zeigt, wie häufig verschiedene Ausgänge eintreten. Sie beantwortet nicht die Frage, was passieren wird, sondern die Frage, was alles passieren könnte.

Der Unterschied ist subtil, aber wichtig. Eine Vorhersage vermittelt oft falsche Sicherheit. Wenn jemand sagt, Bayern werde gewinnen, klingt das definitiv. Aber was, wenn Bayern nur in 60 Prozent der Fälle gewinnt? Dann verlieren sie immer noch in 40 Prozent der Fälle, und eine einzelne Niederlage widerlegt die Vorhersage nicht. Die Simulation macht diese Unsicherheit sichtbar und erlaubt eine ehrlichere Kommunikation.

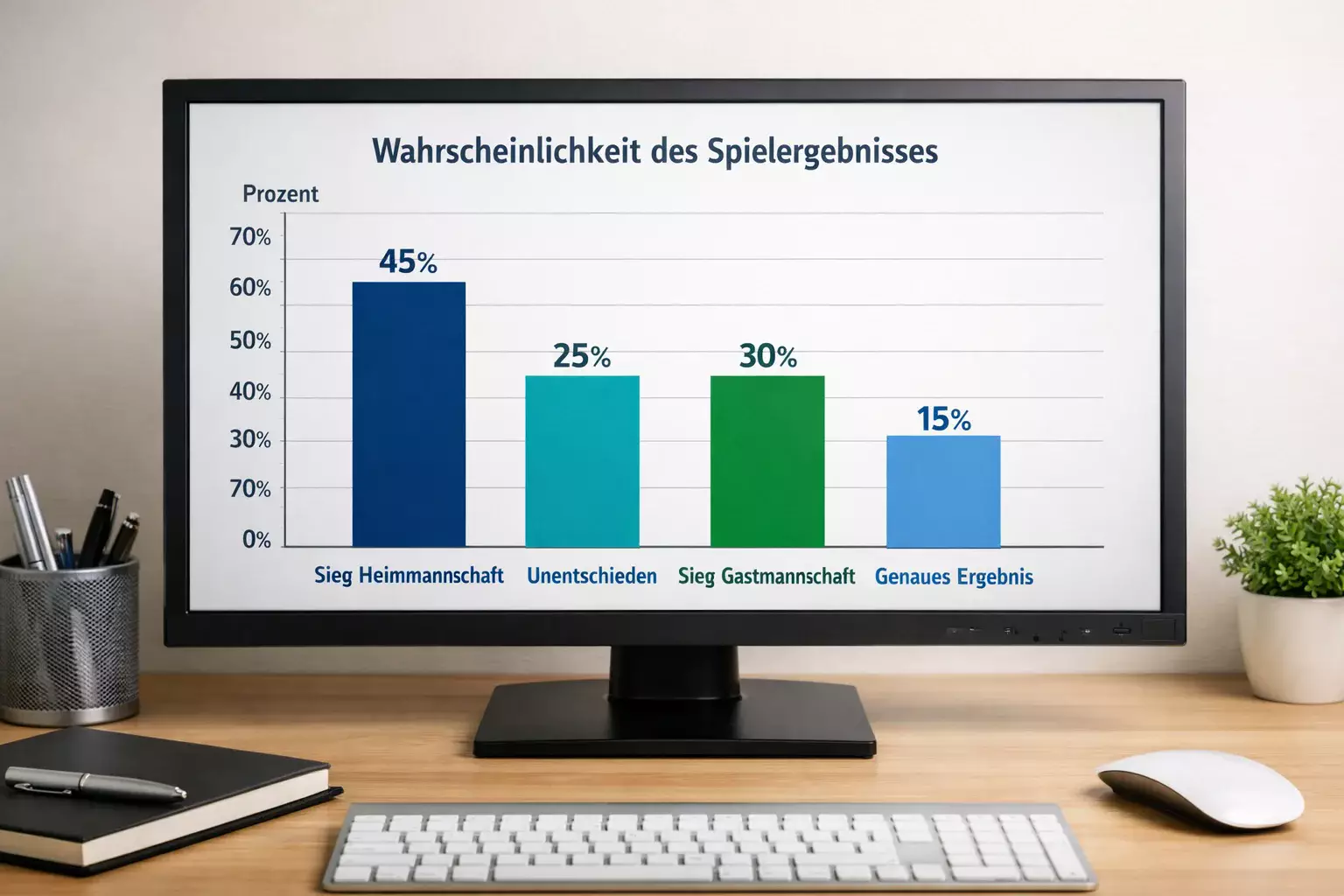

Im Fußball wird auf verschiedenen Ebenen simuliert. Die einfachste Form simuliert einzelne Spiele: Wie oft gewinnt Team A gegen Team B unter den gegebenen Bedingungen? Die nächste Stufe simuliert Spieltage: Wie verteilen sich die Punkte über alle neun Bundesliga-Partien? Die anspruchsvollste Form simuliert ganze Saisons: Wie wahrscheinlich ist es, dass Bayern Meister wird? Dass Köln absteigt? Dass Freiburg sich für die Champions League qualifiziert?

Die Qualität einer Simulation hängt von den Annahmen ab, die in sie eingehen. Ein Modell muss entscheiden, wie es Tore generiert, wie es Spielverläufe modelliert, wie es die Stärken der Teams quantifiziert. Diese Entscheidungen basieren auf Daten und Theorie, aber sie bleiben letztlich Annahmen. Verschiedene Modelle können daher zu unterschiedlichen Ergebnissen kommen, selbst wenn sie dieselbe Methode verwenden.

Die Monte-Carlo-Methode erklärt

Die Monte-Carlo-Methode ist ein Verfahren zur Lösung komplexer Probleme durch zufällige Stichproben. Der Name stammt aus den 1940er Jahren, als Wissenschaftler am Manhattan-Projekt die Methode entwickelten, um Berechnungen für die Atombombe durchzuführen. Sie wählten den Namen als Codewort, inspiriert vom Kasino in Monaco, wo der Zufall regiert.

Die Grundidee ist einfach: Wenn ein Problem zu komplex ist, um es analytisch zu lösen, kann man es durch wiederholte Zufallsexperimente approximieren. Angenommen, Sie wollen die Fläche eines unregelmäßigen Sees berechnen. Eine Möglichkeit wäre, zufällig Punkte auf eine Karte zu werfen und zu zählen, wie viele davon im See landen. Je mehr Punkte Sie werfen, desto genauer wird Ihre Schätzung.

Im Fußball funktioniert das Prinzip ähnlich. Ein Spiel wird als Abfolge von Zufallsereignissen modelliert: Torchancen, die genutzt werden oder nicht, Fehler, die passieren oder nicht, Schüsse, die treffen oder vorbeigehen. Für jedes Ereignis gibt es eine Wahrscheinlichkeit, die aus historischen Daten geschätzt wird. Die Simulation zieht für jedes Ereignis einen Zufallswert und bestimmt so den Ausgang. Am Ende steht ein Spielergebnis.

Ein einzelner Durchlauf liefert ein mögliches Ergebnis, aber es sagt wenig aus, weil der Zufall eine große Rolle spielt. Erst die Wiederholung macht die Methode mächtig. Wenn man denselben Prozess zehntausendmal wiederholt, entsteht eine Verteilung der Ergebnisse. Diese Verteilung zeigt, welche Ausgänge wahrscheinlich sind und welche selten. Sie quantifiziert die Unsicherheit und erlaubt fundierte Aussagen über Wahrscheinlichkeiten.

Die mathematische Begründung liegt im Gesetz der großen Zahlen. Es besagt, dass der Durchschnitt vieler Zufallsziehungen gegen den wahren Erwartungswert konvergiert, wenn die Anzahl der Ziehungen groß genug ist. Je mehr Simulationsdurchläufe, desto genauer die Schätzung. In der Praxis reichen oft einige tausend bis zehntausend Durchläufe für eine stabile Schätzung.

Wie ein einzelnes Spiel simuliert wird

Die Simulation eines einzelnen Fußballspiels beginnt mit der Modellierung der Torerwartungen. Wie viele Tore wird das Heimteam im Durchschnitt erzielen? Wie viele das Auswärtsteam? Diese Erwartungswerte basieren auf den historischen Leistungen beider Mannschaften, bereinigt um den Heimvorteil und andere relevante Faktoren.

Ein typisches Modell verwendet die Poisson-Verteilung, um die Torzahlen zu generieren. Wenn das erwartete Torverhältnis 1,8 zu 1,2 beträgt, zieht die Simulation für jede Mannschaft eine Zufallszahl aus der entsprechenden Poisson-Verteilung. Das Heimteam könnte 0, 1, 2, 3 oder mehr Tore erzielen, wobei Werte nahe am Erwartungswert wahrscheinlicher sind als extreme Werte.

Ein einfaches Modell generiert nur das Endergebnis. Ein komplexeres Modell simuliert den Spielverlauf Minute für Minute. In jeder Minute gibt es eine gewisse Wahrscheinlichkeit für ein Tor, abhängig davon, welche Mannschaft den Ball hat und wie stark sie unter Druck steht. Diese Modelle können die Spieldynamik besser erfassen: Ein frühes Tor verändert die Wahrscheinlichkeiten für den Rest des Spiels, weil die führende Mannschaft defensiver spielen kann.

Die Ereignisse jenseits der Tore können ebenfalls simuliert werden. Rote Karten, Verletzungen, Elfmeter: All das beeinflusst den Spielverlauf und kann in die Simulation integriert werden. Je mehr Details modelliert werden, desto realistischer die Simulation, aber auch desto größer der Rechenaufwand und die Gefahr, dass Fehler in den Annahmen sich aufschaukeln.

Am Ende eines Simulationsdurchlaufs steht ein konkretes Ergebnis, etwa 2:1 für das Heimteam. Dieses Ergebnis ist eine von vielen Möglichkeiten. Erst durch die Aggregation über viele Durchläufe entsteht ein Gesamtbild. Wenn in 3500 von 10000 Simulationen das Heimteam gewinnt, schätzen wir die Siegwahrscheinlichkeit auf 35 Prozent.

Saisonprognosen durch wiederholte Simulation

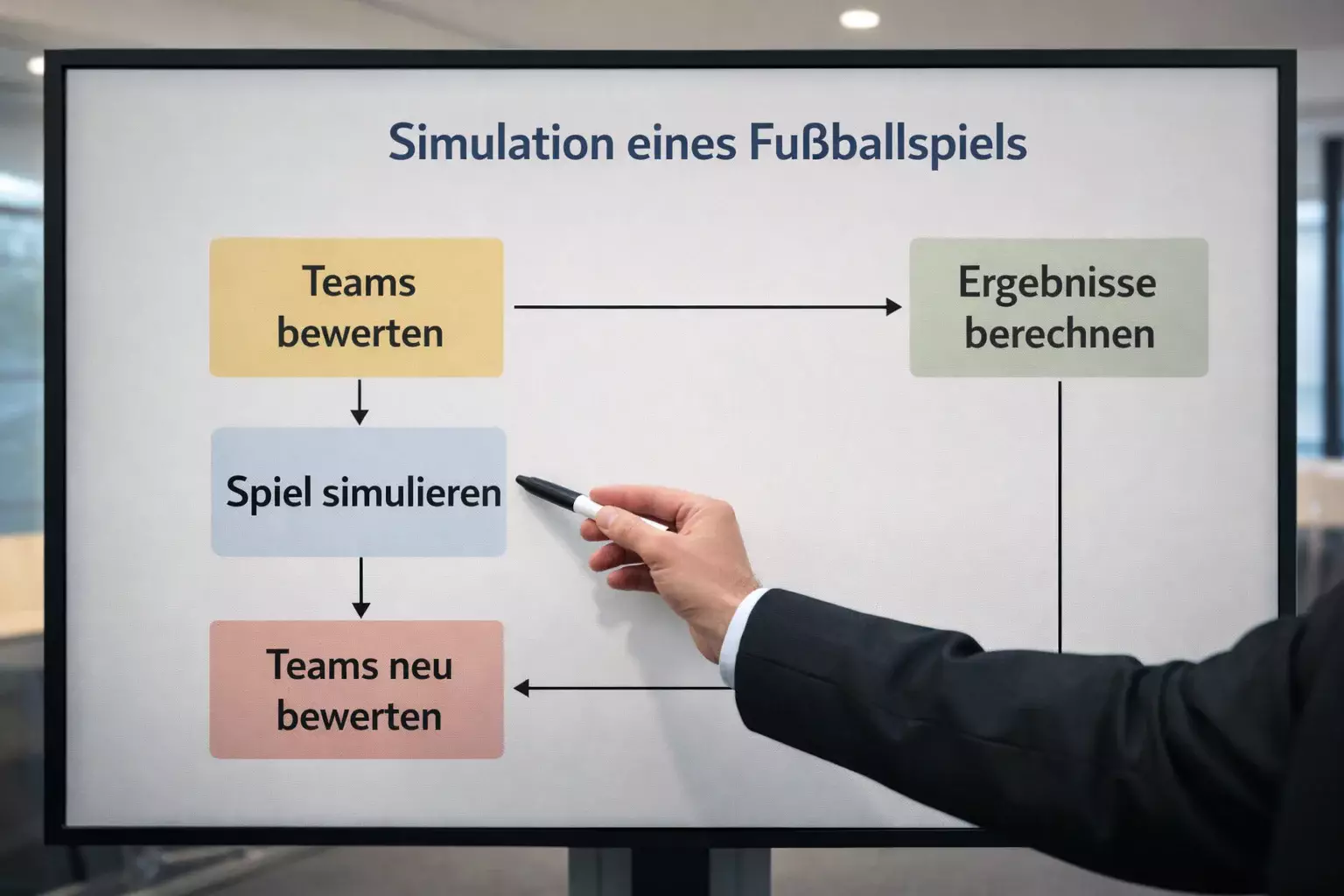

Die wahre Stärke der Monte-Carlo-Methode zeigt sich bei der Simulation ganzer Saisons. Eine Bundesliga-Saison umfasst 306 Spiele, und jedes einzelne beeinflusst die Tabelle. Die Verflechtungen sind komplex: Wenn Bayern einen Spieltag verliert und Dortmund gewinnt, schrumpft der Abstand. Diese Abhängigkeiten machen eine analytische Berechnung der Endtabelle praktisch unmöglich.

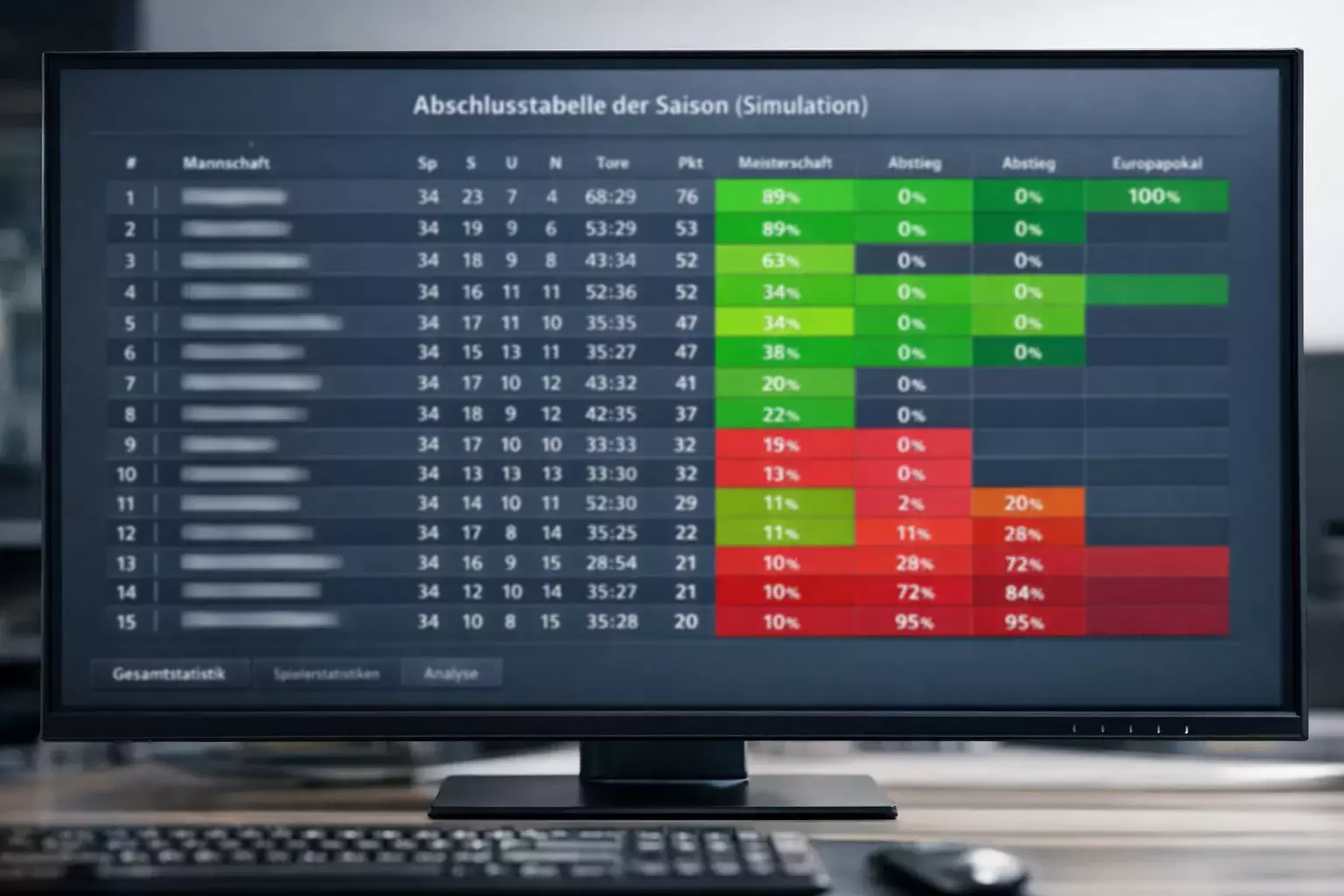

Die Simulation umgeht dieses Problem durch rohe Rechenkraft. Sie spielt jedes Spiel der Saison einzeln durch, aktualisiert die Tabelle nach jedem Spieltag und wiederholt den gesamten Prozess zehntausendmal. Am Ende hat sie zehntausend mögliche Abschlusstabellen, aus denen sich Wahrscheinlichkeiten ableiten lassen.

Die Meisterschaftswahrscheinlichkeit ergibt sich aus dem Anteil der Simulationen, in denen ein bestimmtes Team am Ende auf Platz eins steht. Wenn Bayern in 7200 von 10000 Simulationen Meister wird, beträgt ihre Meisterschaftswahrscheinlichkeit 72 Prozent. Analog lassen sich Abstiegswahrscheinlichkeiten, Chancen auf internationale Plätze und andere Szenarien berechnen.

Die Fehlerbalken bei Saisonprognosen sind groß, insbesondere zu Beginn der Saison. Nach nur wenigen Spieltagen ist die Unsicherheit enorm, weil viele Spiele noch ausstehen und jedes einzelne die Tabelle verändern kann. Im Saisonverlauf schrumpft die Unsicherheit, weil die verbleibenden Möglichkeiten weniger werden. Kurz vor Saisonende sind die Prognosen entsprechend präziser.

Die Aktualisierung der Simulationen ist ein wichtiger Aspekt. Nach jedem Spieltag werden die neuen Ergebnisse eingearbeitet, die verbleibenden Spiele neu simuliert und die Wahrscheinlichkeiten aktualisiert. Ein Team, das überraschend Punkte verliert, sieht seine Meisterschaftschancen sinken. Ein Aufsteiger, der besser spielt als erwartet, verbessert seine Perspektiven. Die Simulation passt sich kontinuierlich an die Realität an.

Ergebnisse interpretieren

Die Interpretation von Simulationsergebnissen erfordert ein gewisses Verständnis für Wahrscheinlichkeiten. Eine häufige Fehlinterpretation ist die Verwechslung von Wahrscheinlichkeit und Gewissheit. Wenn eine Simulation sagt, dass ein Team mit 70 Prozent Wahrscheinlichkeit gewinnt, bedeutet das nicht, dass es gewinnen wird. Es bedeutet, dass es in etwa sieben von zehn ähnlichen Situationen gewinnen würde.

Die Konfidenzintervalle geben Auskunft über die Unsicherheit der Schätzung. Wenn die Simulation 10000 Durchläufe umfasst und in 6000 davon das Heimteam gewinnt, liegt die geschätzte Wahrscheinlichkeit bei 60 Prozent. Aber diese Schätzung hat einen Fehler. Das 95-Prozent-Konfidenzintervall könnte etwa 59 bis 61 Prozent betragen. Bei weniger Durchläufen wäre das Intervall breiter, bei mehr Durchläufen schmaler.

Die Sensitivität gegenüber Annahmen ist ein weiterer wichtiger Aspekt. Simulationsergebnisse hängen von den Parametern ab, die in das Modell eingehen. Wenn die erwarteten Torzahlen falsch geschätzt sind, werden auch die Simulationsergebnisse falsch sein. Gute Analysten variieren die Parameter systematisch, um zu sehen, wie stark die Ergebnisse davon abhängen. Eine Vorhersage, die bei kleinen Änderungen der Annahmen stark schwankt, ist weniger zuverlässig als eine, die stabil bleibt.

Die Aggregation über verschiedene Modelle kann die Robustheit erhöhen. Wenn mehrere unabhängige Simulationsmodelle zu ähnlichen Ergebnissen kommen, steigt das Vertrauen in diese Ergebnisse. Wenn sie stark voneinander abweichen, ist Vorsicht geboten. Die Wahrheit liegt irgendwo dazwischen, aber wo genau, ist unklar.

Wenn die Simulation vom Ergebnis abweicht

Eine einzelne Abweichung zwischen Simulation und Realität sagt wenig aus. Wenn die Simulation eine 60-prozentige Siegwahrscheinlichkeit für das Heimteam vorhersagt und das Auswärtsteam gewinnt, ist das kein Fehler der Simulation. Es ist ein Ereignis, das in 40 Prozent der Fälle eintreten sollte, und es ist eingetreten. Das ist Statistik, nicht Versagen.

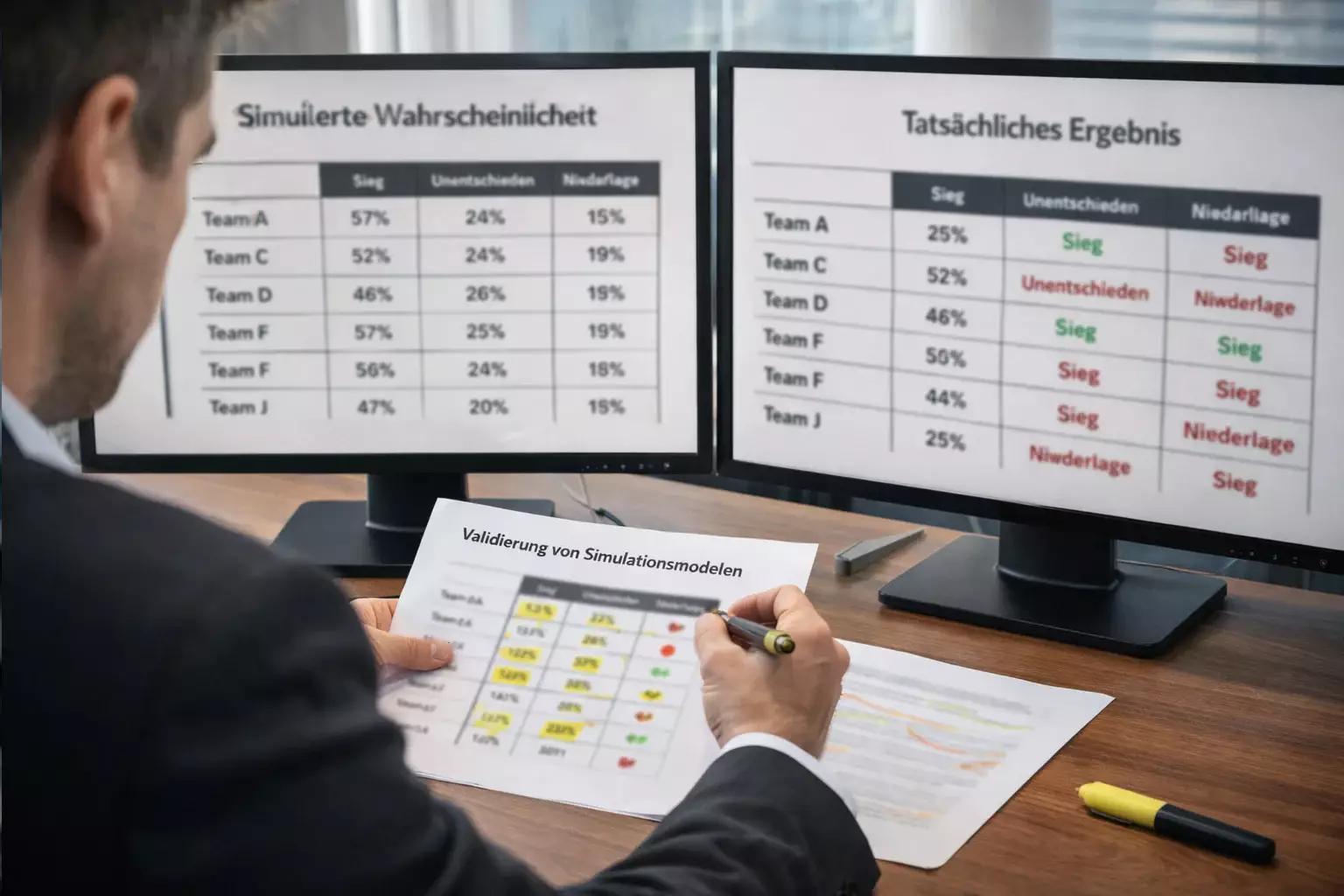

Die systematische Überprüfung erfordert viele Spiele. Wenn die Simulation über hunderte von Spielen hinweg Wahrscheinlichkeiten angibt, kann man überprüfen, ob diese Wahrscheinlichkeiten kalibriert sind. Von allen Spielen, bei denen die Simulation eine 60-prozentige Heimsiegwahrscheinlichkeit angab, sollten etwa 60 Prozent tatsächlich mit einem Heimsieg enden. Wenn der Anteil systematisch höher oder niedriger ist, stimmt etwas mit dem Modell nicht.

Die Kalibrierung ist eine wichtige Qualitätsmetrik für Simulationsmodelle. Ein gut kalibriertes Modell liefert Wahrscheinlichkeiten, die der Realität entsprechen. Ein schlecht kalibriertes Modell unter- oder überschätzt systematisch bestimmte Ausgänge. Die Überprüfung der Kalibrierung erfordert Geduld, weil viele Spiele beobachtet werden müssen, bevor statistische Aussagen möglich sind.

Die kontinuierliche Verbesserung ist Teil des Prozesses. Kein Modell ist perfekt, und die Abweichungen zwischen Simulation und Realität liefern wertvolle Informationen. Wenn bestimmte Spieltypen systematisch schlechter vorhergesagt werden als andere, deutet das auf Schwächen im Modell hin. Diese Schwächen können adressiert werden, indem die Annahmen angepasst oder neue Daten integriert werden.

Die Rolle der Zufallszahlen

Die Monte-Carlo-Simulation basiert auf Zufallszahlen, und die Qualität dieser Zahlen beeinflusst die Ergebnisse. Computer können keine echten Zufallszahlen erzeugen, sondern nur Pseudozufallszahlen, die durch deterministische Algorithmen generiert werden. Für die meisten Anwendungen sind diese Pseudozufallszahlen gut genug, aber es gibt subtile Fallen.

Ein guter Zufallszahlengenerator produziert Zahlen, die gleichmäßig verteilt und unkorreliert sind. Wenn der Generator Muster produziert, etwa weil bestimmte Zahlen häufiger vorkommen als andere, können die Simulationsergebnisse verzerrt werden. Moderne Generatoren wie der Mersenne Twister sind für praktische Zwecke zuverlässig, aber bei sehr vielen Simulationsdurchläufen kann es zu Problemen kommen.

Die Reproduzierbarkeit ist ein weiterer Aspekt. Wenn man eine Simulation mit demselben Startwert für den Zufallszahlengenerator wiederholt, erhält man dieselben Ergebnisse. Das ist nützlich für Debugging und Vergleiche, aber es bedeutet auch, dass die Ergebnisse von der Wahl des Startwerts abhängen. Gute Praxis ist es, mehrere Durchläufe mit verschiedenen Startwerten zu machen und die Ergebnisse zu vergleichen.

Die Anzahl der Durchläufe ist eine Abwägung zwischen Genauigkeit und Rechenzeit. Mehr Durchläufe führen zu präziseren Schätzungen, aber irgendwann bringt jeder weitere Durchlauf nur noch marginale Verbesserungen. Die Standardabweichung der Schätzung sinkt mit der Wurzel aus der Anzahl der Durchläufe. Um die Genauigkeit zu verdoppeln, braucht man also viermal so viele Durchläufe. In der Praxis sind 10.000 bis 100.000 Durchläufe ein guter Kompromiss.

Simulation im Kontext anderer Methoden

Die Monte-Carlo-Simulation ist nicht die einzige Methode zur Fußballprognose, und sie sollte im Kontext anderer Ansätze betrachtet werden.

Analytische Methoden liefern exakte Lösungen, wenn das Problem einfach genug ist. Für die Berechnung der Wahrscheinlichkeit eines bestimmten Spielausgangs unter der Poisson-Annahme braucht man keine Simulation, sondern kann die Wahrscheinlichkeit direkt berechnen. Simulationen werden dann nötig, wenn die Problemstellung zu komplex für eine analytische Lösung wird, etwa bei der Berechnung von Tabellenwahrscheinlichkeiten.

Machine-Learning-Methoden können Muster in den Daten erkennen, die in den Simulationsannahmen nicht enthalten sind. Ein neuronales Netz könnte etwa lernen, dass bestimmte Trainerwechsel einen größeren Effekt haben als andere, ohne dass dies explizit modelliert werden muss. Die Kombination von Simulation und Machine Learning kann die Stärken beider Ansätze vereinen.

Expertenwissen bleibt wertvoll. Keine Simulation kann alle relevanten Informationen erfassen. Ein erfahrener Analyst kann Faktoren berücksichtigen, die in keinem Datensatz enthalten sind: die Stimmung in der Mannschaft, die Motivation des Trainers, die Bedeutung eines bestimmten Spiels. Die besten Prognosen entstehen oft durch die Kombination von Simulation und menschlichem Urteil.

Grenzen der Simulationsmethode

Die Monte-Carlo-Simulation ist mächtig, aber sie hat Grenzen, die kein Algorithmus überwinden kann.

Die Qualität der Eingangsdaten ist entscheidend. Eine Simulation kann nur so gut sein wie die Parameter, die in sie eingehen. Wenn die erwarteten Torzahlen falsch sind, werden auch die Simulationsergebnisse falsch sein. Die Schätzung dieser Parameter ist selbst eine komplexe Aufgabe, die alle Unsicherheiten der statistischen Analyse mit sich bringt.

Die Unabhängigkeitsannahme ist oft verletzt. Die meisten Simulationen nehmen an, dass die Ergebnisse verschiedener Spiele unabhängig voneinander sind. In der Realität gibt es Korrelationen: Wenn mehrere Spitzenteams am selben Wochenende schwächeln, könnte das an gemeinsamen Faktoren liegen, etwa an der Europapokalbelastung. Solche Abhängigkeiten zu modellieren ist schwierig und wird oft vernachlässigt.

Die seltenen Ereignisse sind schwer zu erfassen. Wenn ein Ereignis nur in einer von tausend Simulationen auftritt, ist die Schätzung seiner Wahrscheinlichkeit sehr unsicher. Um seltene Ereignisse zuverlässig zu quantifizieren, braucht man entweder sehr viele Simulationsdurchläufe oder spezielle Techniken, die seltene Szenarien überproportional oft simulieren.

Die fundamentale Unvorhersehbarkeit des Fußballs bleibt bestehen. Eine Simulation kann die Wahrscheinlichkeiten schätzen, aber sie kann nicht garantieren, was passieren wird. Der Außenseiter kann gewinnen, der Favorit kann verlieren, und keine Simulation ändert daran etwas. Die Demut vor dem Zufall ist auch bei den ausgeklügeltsten Methoden angebracht.

Praktische Anwendung für Wettinteressierte

Wer Simulationsergebnisse für Wettentscheidungen nutzen möchte, sollte einige praktische Hinweise beachten.

Der Vergleich mit den Buchmacherquoten ist der erste Schritt. Die Quoten der Buchmacher implizieren Wahrscheinlichkeiten, die mit den Simulationsergebnissen verglichen werden können. Wenn die Simulation eine höhere Wahrscheinlichkeit für ein Ereignis schätzt als der Buchmacher, könnte das eine Value-Wette sein. Aber Vorsicht: Die Buchmacher haben auch gute Modelle, und Abweichungen können ebenso gut auf Fehler in der eigenen Simulation hindeuten.

Die Unsicherheit der Schätzung sollte berücksichtigt werden. Eine geschätzte Wahrscheinlichkeit von 55 Prozent bei breitem Konfidenzintervall ist weniger verlässlich als eine von 55 Prozent bei schmalem Intervall. Bei großer Unsicherheit ist konservatives Wetten angebracht, bei kleiner Unsicherheit kann man eher auf kleine Vorteile setzen.

Die langfristige Perspektive ist entscheidend. Einzelne Wetten können gewonnen oder verloren werden, unabhängig von der Qualität der Analyse. Der wahre Test einer Strategie liegt in der Performance über viele Wetten hinweg. Wer nach einigen Fehlschlägen die Strategie verwirft, gibt ihr keine faire Chance.

Verschiedene Simulationsansätze im Vergleich

Es gibt verschiedene Philosophien, wie Fußballspiele simuliert werden können. Jeder Ansatz hat seine Stärken und Schwächen, und die Wahl hängt vom Anwendungsfall ab.

Der ergebnisorientierte Ansatz simuliert nur das Endergebnis, nicht den Spielverlauf. Er ist einfach zu implementieren und rechnerisch effizient. Die Poisson-Verteilung für Tore ist ein klassisches Beispiel. Der Nachteil ist, dass die Spieldynamik ignoriert wird: Ein 2:0 nach 60 Minuten führt zu anderen Spielmustern als ein 0:0 zur selben Zeit.

Der verlaufsbasierte Ansatz simuliert das Spiel Minute für Minute oder sogar Ereignis für Ereignis. Er kann die Dynamik besser erfassen: Ein frühes Tor verändert die Wahrscheinlichkeiten für den Rest des Spiels. Der Nachteil ist die höhere Komplexität und die Notwendigkeit, viele zusätzliche Parameter zu schätzen.

Der agentenbasierte Ansatz geht noch weiter und simuliert das Verhalten einzelner Spieler. Jeder Spieler hat eine Position, Bewegungsmuster und Entscheidungsregeln. Das Spiel entsteht aus der Interaktion der 22 Agenten. Dieser Ansatz ist am realistischsten, aber auch am aufwändigsten und am anfälligsten für Fehler in den vielen Parametern.

Die Wahl des Ansatzes hängt vom Zweck ab. Für eine schnelle Einschätzung von Siegwahrscheinlichkeiten genügt oft der ergebnisorientierte Ansatz. Für die Analyse von In-Play-Wetten ist ein verlaufsbasierter Ansatz besser geeignet. Für die Entwicklung von Spielstrategien könnte ein agentenbasierter Ansatz interessant sein.

Validierung und Qualitätskontrolle

Eine Simulation ist nur so gut wie ihre Validierung. Es gibt verschiedene Methoden, um die Qualität eines Simulationsmodells zu überprüfen.

Der Backtesting-Ansatz wendet das Modell auf historische Daten an und vergleicht die Vorhersagen mit den tatsächlichen Ergebnissen. Wenn das Modell in der Vergangenheit gute Prognosen geliefert hätte, spricht das für seine Qualität. Aber Vorsicht: Ein Modell, das auf historischen Daten trainiert wurde, wird diese Daten tendenziell gut erklären. Der eigentliche Test ist die Performance auf neuen, ungesehenen Daten.

Die Kreuzvalidierung teilt die Daten in mehrere Gruppen auf. Das Modell wird auf einem Teil der Daten trainiert und auf dem Rest getestet. Durch Rotation der Gruppen erhält man eine robustere Schätzung der Modellqualität als durch einmaliges Backtesting.

Die Out-of-Sample-Validierung ist der härteste Test. Das Modell wird auf Daten bis zu einem bestimmten Zeitpunkt trainiert und dann auf zukünftige Spiele angewendet. Nur die Performance auf diesen zukünftigen Spielen zählt. Diese Methode entspricht am besten der realen Anwendung, aber sie erfordert Geduld, weil man auf neue Spiele warten muss.

Verantwortungsvoller Umgang mit Simulationen

Simulationen sind Werkzeuge, keine Kristallkugeln. Sie können helfen, bessere Entscheidungen zu treffen, aber sie können die grundsätzlichen Risiken des Wettens nicht eliminieren.

Die Verlockung der scheinbaren Präzision ist groß. Wenn eine Simulation eine Wahrscheinlichkeit von 63,7 Prozent ausgibt, suggeriert das eine Genauigkeit, die nicht vorhanden ist. Die Differenz zwischen 63 und 64 Prozent ist in der Praxis bedeutungslos, weil die Unsicherheit der Schätzung viel größer ist. Gute Analysten kommunizieren ihre Ergebnisse mit angemessener Vorsicht und runden auf sinnvolle Werte.

Das Bankroll-Management bleibt wichtig. Selbst wenn die Simulation einen Vorteil identifiziert, kann eine Serie von Verlusten das Kapital aufbrauchen. Die Einsätze sollten so gewählt werden, dass auch längere Pechsträhnen überstanden werden können. Die optimale Strategie hängt von der Größe des Vorteils und der verfügbaren Bankroll ab. Die Kelly-Formel bietet einen mathematischen Rahmen für diese Entscheidung, aber sie sollte mit Vorsicht angewendet werden.

Die emotionale Distanz ist eine Herausforderung. Wer viel Zeit in die Entwicklung einer Simulation investiert hat, neigt dazu, ihre Ergebnisse zu überschätzen. Die eigene Arbeit kritisch zu hinterfragen ist schwer, aber notwendig. Ein unabhängiger Blick von außen kann helfen, blinde Flecken zu erkennen.

Schließlich sollte der Spaß am Spiel nicht verloren gehen. Fußball ist mehr als eine Rechenaufgabe, und die Simulation sollte das Erlebnis bereichern, nicht ersetzen. Die Spannung eines Spiels, die Freude über ein unerwartetes Tor, die Enttäuschung über eine Niederlage: All das gehört zum Sport und sollte durch keine noch so ausgefeilte Analyse verdrängt werden. Die Zahlen sind eine Ergänzung, keine Alternative zum Erlebnis des Spiels.